A/B测试,国内外为何「冰火两重天」

撰文 | 郭朝飞

抖音为什么叫抖音?

当然,这不是张一鸣拍脑袋的结果,它与字节跳动内部一个名为A/B测试的工具有关。

抖音做出产品demo之后,起了很多名字,各自logo也不同。他们将这些名字放在不同应用市场,但位置、预算等条件是一致的,测试了各自对用户的吸引力程度、下载转化率等指标。

抖音当时排第二,团队讨论后认为,长期来看抖音更符合认知,也更能体现产品形态,就选了这个“第二名”。

从最初的今日头条,到后来的抖音、西瓜视频,再到懂车帝、飞书等构建成的产品矩阵,外界一直好奇,字节跳动持续迭代的方法论到底是什么?

事实上,在字节跳动过去的九年间,大量的A/B测试几乎每天都在进行。就在不久前,字节跳动旗下面向企业的智能科技品牌——火山引擎举行品牌发布会,基于大数据、人工智能和基础服务等技术能力,为企业提供系统化的全链路解决方案,助力企业务实地创新,给企业带来持续、快速增长,而A/B测试是火山引擎智能营销套件中的一个工具。

如果说字节快速迭代的秘诀是数据驱动的话。A/B测试是最能够体现数据驱动价值,也最能代表数据驱动理念的。

事实上,A/B测试早已在亚马逊、谷歌等海外互联网公司被广泛应用和传承。

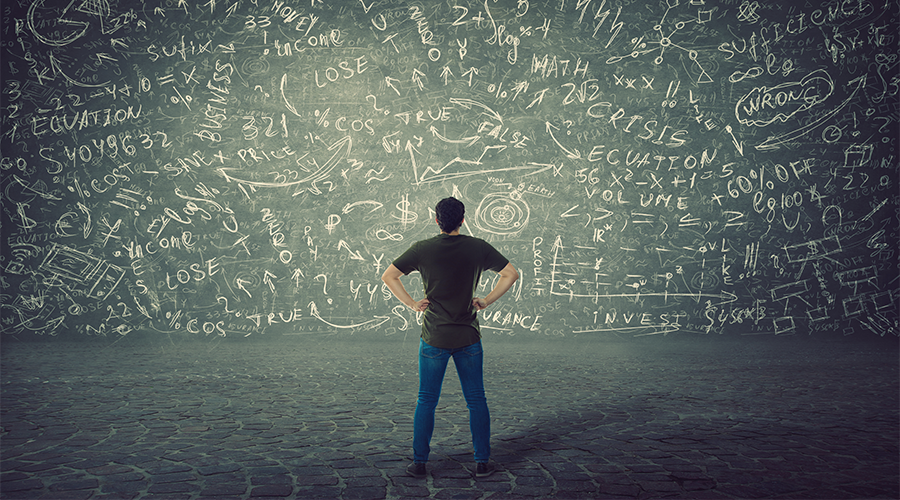

但在国内,A/B测试还处于初级阶段。不久前,火山引擎市场部做过一个市场调研。1000家企业的样本数据显示:在企业的日常业务和管理中,A/B测试的普及率并不高,渗透率不足30%。

A/B测试到底是什么?有何神奇之处?既然如此强大,在国内外市场为何“冰火两重天”?

A/B测试并不是互联网的专利

互联网圈有一句话,顶级PM(产品经理)只能跑赢一半A/B实验。

但如果追溯起来,A/B测试并不是互联网的专利。很早的时候,A/B实验就被用于医药实验等科研领域,比较著名的便是英国海军外科医生詹姆斯·林德出海,在船上用临床实验治疗坏血病的案例。

那是1747年,航行中很多人患上坏血病。林德选了12名比较严重的病例,分为6组,在6天的时间里,把他们安排在一起,吃食完全一样。实验的关键之处在于,根据当时的流传说法,给每组吃不同的可能治疗坏血病的东西。比如,一组每天吃两个橘子、一个柠檬,一组喝苹果汁,其他方案还包括喝酸醋、海水等。后来,实验证明吃橘子、柠檬是有用的。

回过头来看,该实验未必完全严谨,比如患者的年龄、民族、地区等问题是否考虑进去。时至今日,其背后蕴含的A/B实验精神与理念已经进入多个领域和行业,尤其在互联网行业被广泛应用。

A/B实验,又被称为小流量实验。在互联网领域,简单说就是针对要改进的某项功能、UI、逻辑策略等,提供两种或多种备选方案,从总体用户中抽取一小部分,随机将抽取出的流量分配给不同方案。比如让一部分用户使用A方案,一部分用户使用B方案,最终结合一定的统计方法,通过实验数据对比来确定最优方案。

A/B测试在互联网公司大规模应用,是在美国的谷歌、亚马逊、Facebook等公司。

一位有谷歌工作经历的人士透露,谷歌用A/B测试最广泛的是搜索、广告两大团队,因为这两项业务用户量超级大,结果都容易用数据衡量。

上述人士透露,他曾在谷歌总部工作过一段时间,他当时的主要任务就是通过改进谷歌搜索广告的产品,来提升谷歌广告点击率和营收。

当时,谷歌每月搜索广告的产品上会做几百、上千次实验,他会尝试不同的产品改动,不同的优惠策略、卖点,看看哪个转化率更高。他发现,100个实验版当中,可能60~70个都对用户没有影响,剩下的几十个版本中,有十几个可能会比正在用更好,把这些更好的版本上线、推给更多的用户,就可以持续提升转化率,高效率地试错。

谷歌翻译设计师Pendar Yousefi与Olivia Grace在一篇文章中指出,在谷歌翻译网页版的改版中,A/B测试就起到了重要作用。

一开始谷歌将翻译结果文本框做成了蓝底白字,但用户反馈不好。重新设计时,很多设计人员犹豫甚至质疑,是否要换掉蓝底白字。

谷歌做了A/B测试,一组实验用蓝底白字,另一组用灰底黑字。A/B测试的结果显示,采用蓝底白字的翻译结果文本框后,用户使用谷歌翻译的频率和次数明显减少。最终,为了便于长篇翻译结果的可读性,谷歌还是改了过来。

“虽然有种种不情愿,但我们还是将蓝底白字更新成了灰底黑字。”Pendar Yousefi与Olivia Grace在文章中写道。

相比谷歌,亚马逊的产品更复杂、繁琐,运营策略也更复杂,因此亚马逊的实验数量更多,因为它可以优化的点特别多。

贝索斯曾经说过,亚马逊的成功,秘诀就是每年、每月、每天不断进行实验。

字节跳动一位高级实验工程师曾这样描述A/B测试:一方面我们无法承担任何一个错误特性影响上亿用户体验的严重后果;另一方面我们又希望能够分离并量化每个特性的影响。

这就需要我们设计并坚持使用一套数据驱动的方法,使得我们可以以较小的风险对新特性进行评估,积极试错积累经验;并且这个方法有能力排除其他因素(如同时开发的其他特性、时间因素等)的干扰;最后,除了"好'或者'不好",我们希望这个方法也能够给出定量的结果。

为了解决上述问题,普遍使用的方法是小流量随机实验,也就是A/B实验。

理念和认知受限

在国内,A/B测试也算不上新鲜事物。

一位资深互联网运营人记得,2012年前后他第一次接触A/B测试,彼时A/B测试与精益创业等理念一同从外国传入。后来创业时,他第一次将A/B测试应用于课程详细页的版本测试中。

但不得不承认,目前A/B测试在国内关注度并不高,普及程度与影响力也远不及美国市场。

从根子上说,A/B测试首先不是技术问题,而是理念与认知问题。

在前述管理者看来,一些国家的教育体系中,贯穿着类似A/B测试的理念,比如早在幼儿园时期,就会让儿童观测豆子生长过程中淋水与不淋水的差异。当这种A/B测试、实验系统根植于理念中时,在产业界、企业界就不用推广,是自然而然的选择。

在国内市场,很多时候决策者判断是否要做A/B测试,不是根据数据判断,更多是依据经验。这里的决策者是广义的,可能是技术总监、产品总监,也可能是产品经理、研究人员。一些团队会认为,某个产品的好坏,产品经理可以根据用户洞察、产品价值洞察来判断,最重要的、最关键的是产品经理的个人能力。

事实上,决策者也明白A/B测试的重要性,但并不认为它是最重要的。原因在于,在他们看来,不做A/B测试可能不会直接影响产品的成败,也不会直接决定产品的后续发展。

对于企业来说,是否选择A/B测试,还需要平衡成本与效率的问题。选择做A/B测试,不仅有研发成本,还有时间成本。也就是说,搭建测试系统需要支出更多开发版本,搭建完成后,还要经历一个测试、等待、决策的时间周期。

从管理角度来看,是否做A/B测试,完全依赖于怎么算账。一个应用如果不做精细测试,很可能发展了三四个月之后发现,方向不对,就会浪费时间和机会;但是做测试,就需要投入金钱成本。总的来说,提前通过测试来试错,结果会更高效。

“所以为什么越大的团队、大厂越容易做A/B测试,而越小的公司就越难?”前述管理者提醒道。

据火山引擎一位数据智能解决方案负责人透露,他们做过调研和沙盘推演后发现,企业自建A/B测试平台会涉及到各种技术成本和运维成本。小企业虽然存在刚需,但是自建系统压力大。

所以,最终的行业走向应该是,企业无需自行搭建测试系统,尤其是传统企业、创业公司,可以采购第三方的产品与服务,把专业的事交给专业的人。目前已有字节跳动这样的大厂,通过自己的ToB品牌火山引擎开放相关产品,是做A/B测试的不错选择。

并非“万能公式”

A/B测试系统的研发,护城河并不低。

因此,对于采购A/B测试的公司来说,尴尬之处就是国内市场可选择的标的并不多,而且相当一部分还是小规模公司,这也是当前国内A/B测试发展缓慢原因之一。

在火山引擎A/B测试的一位产品工程师看来,准确的分流是A/B测试的基础门槛,A/B测试平台要保证科学的流量分割、流量层直接的正交互斥,使得实验不受干扰。

“如果分流不准,实验效果就肯定不准,就不知道怎么去迭代你的推荐模型,然后不能更多地留住用户,不能卖更多的广告,这是一个完整的链条。”这位产品架构师补充道。

此外,更复杂的是指标设计和解读以及置信度的统计方法,一旦出现失误,更易导致错误的结论。

因此,在A/B测试中存在很多“坑”,一不小心就会出错。

比如,经常被采用的奇偶数分流,就是一种错误的分流方式。

有些企业通过用户的ID尾号奇偶性做分流测试。虽然从极限理论上来看,奇数和偶数各占一半,看起来没有什么问题。但是从实操上来看,企业的数据的充分积累达到极限的边界并不现实,而且用这些数据来做A/B测试,更是完全违背了小流量实验的原则。

实际上,A/B测试要求,尽可能地保持实验组和对照组流量分布一致(与总体流量也需保持分布一致),否则得出的实验数据并不具有可信性。

再比如,A/B测试中不能只简单观测实验数据的涨跌,不考虑实验结果是否显著。这是因为,实验观测得到的是样本数据,不是整体数据。如果只对数据进行简单的计算,对于实验结果的判断很可能会出错。

因此,需要结合统计学的方法,在评估实验结果时加入相应的统计学指标,如置信度、置信区间、统计功效等。原则上,如果实验结果不显著,或者说不置信,便不能判断数据的涨跌,是否是由实验中采取的策略造成的,也可能由抽样误差造成的,就不能盲目地全量发布新策略/否定新策略。

当然,有必要提及的是,A/B测试不是万能的,并不一定适用于所有场景。

用字节跳动副总裁杨震原的话说,“A/B测试不一定是最好的评估方法,它不是万能的,但是我觉得,不会A/B测试肯定是不行的。”

破局者出现

审校 | 陈秋霖

END