Facebook 这次有人情味!要用 AI 找出那些有自杀倾向的用户 | 潮科技

Facebook 能利用它所知道的信息来阻止某人自杀吗?

刚过去的 1 月,一名年仅 12 岁的女孩称由于受到家庭成员性虐待,决定上吊自杀,她用社交媒体平台 Live.Me 直播了整个过程。最终这段令人痛心的视频在网络上疯传,多达数百万人透过 Facebook、Youtube 等媒体看过她自绝画面。

华盛顿邮报称,YouTube 及时清除了这段令人不安的视频及不同版本,但就在其删除视频后,自杀视频仍在 Facebook 上存活了两周才被彻底删除。

失望不可避免,毕竟 Facebook 月活已超 17 亿,意味着要承担相应的重责,但对这段自杀视频的处理, Facebook 表现得有些无力。

扎克伯格 2 月份的宣言,意味着 Facebook 即将开启新篇章,以匹配对世界近 20 亿人口的影响力。周三,Facebook 表示为建立个更安全,彼此支持的 Facebook 社区,宣布要大力加强自己的自杀预防工具,它将用人工智能来识别有自杀倾向的用户。

事实上,早在十年前 Facebook 就有了自杀报告,这些年各种防自杀工具也频频现身,比如你可标记有自杀倾向的内容,向 Facebook 报告;针对好友有自杀倾向,你可以借助 Facebook 系统表达关切,若选择直接与好友沟通,Facebook 还能为沟通措辞提供建议等。

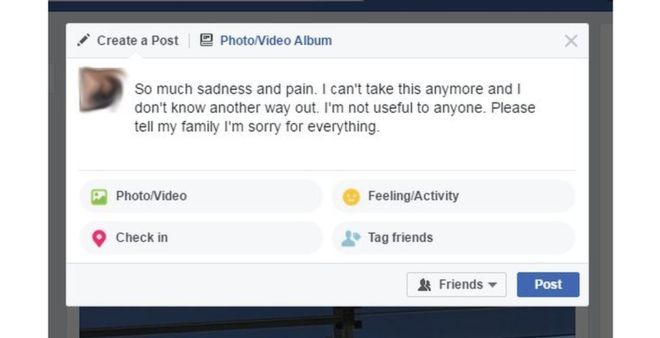

但基于用户手动操作所起作用终究有限,可能会无意错过,或忽略了一些小细节。人工智能恰能弥补这些缺失,Facebook 正测试一个识别系统,该系统是基于对以往有自杀风险帖子的模式识别。

AI 工具会对帖子中那些字眼进行分析,尤其是来自朋友的评论,比如“你好吗?”、“我很担心你”就是两种不同的情绪,相应会触发不同的信号。

检测到问题后,Facebook 社区团队会对帖子进行审核,确认后会与有潜在自我伤害风险的人联系,建议他们寻求帮助。同时,人工智能会针对用户亲友突出显示“自杀或自我伤害”报告,让亲友们意识可能存在问题。

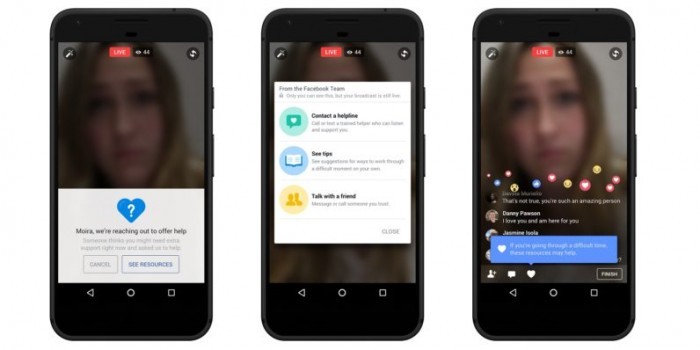

自杀监测工具也被整合到 Facebook Live 和 Messenger 中。对直播服务的植入,也是为了避免重复 12 岁女孩的悲剧,当直播中的内容令人不安,你即可与播主联系,同时反馈情况至 Facebook ,分享视频的人也能看到包含帮助信息的提示。

当用户帖子被标记出来,而且他们愿意与他人对话时,Messenger 可作为连接“危险用户”与专业人士的桥梁,美国自杀求助热线、美国饮食紊乱协会、危机热线等组织都将提供相关帮助。

目前这种合作伙伴实时提供帮助,以及 AI 识别技术还处于美国小范围的测试中。

回过头想,全球每 40 秒就有一人自杀,自杀也是 15 岁至 24 岁人群的第二大死亡原因,如此普遍的情况下,Fackbook 预防自杀工具有多大的作用?

至少对孤身准备赴死的人来说,泉涌般而至的关切或许能将他们从死亡的边缘拉回来。别否认这种尝试的价值,技术能帮助捕捉你可能遗漏的信号,而这或许恰好决定你能否及时干预,阻止那些悲惨的事发生。正如 Facebook COO Sheryl Sandberg 写道:

作为社区,我们也许不能阻止每一次自杀,但必须为那些挣扎中的人们做更多事;作为个人,我们要能够警觉自己和他人的行迹,并且快速应对。当聚到一块时,我们就能一直都在那,在深陷痛苦的人们身边。

但另一个角度看来,基于用户手动反馈不良倾向或许还好,加入人工智能以后呢?

AI 系统逐字逐句识别你和你亲朋好友的话语、情绪,对隐私敏感的用户来说,也是一种挑战,毕竟时刻被“盯”着的感觉并不好,冷不丁情绪不佳的时候还有来自 Facebook 系统的问候。

另外,还有问题是,AI 系统会将你状态不佳的信息传递给好友列表中的谁?或许你不会想让某些人知道。

所以,你认为 Facebook 这样做如何呢?

这是国际新闻组的新栏目:潮科技。科技大公司的最新技术、潜力公司的酷产品、在实验室茁壮成长的新概念,都逃不过我们的法眼!够潮够先进,才有够得着的未来市场。

欢迎提出意见和建议,可以在下方评论区留言,36氪想为你变得更好。